MEGAZONEブログ

AWS re:Invent 2024 ピーター・デサント マンデーナイトライブセッション

AWS re:Invent 2024 Monday Night Live with Peter DeSantis

講演概要

Title: Monday Night Live with Peter DeSantis

Date: 2024年12月2日(月)

Venue: Venetian

Speaker:

Dave Brown (VP、AWS Compute & Networking、Amazon)

Tom Brown (Co-founder and Chief Compute Officer, Anthropic)

Peter DeSantis (SVP、Utility Computing、Amazon Web Services)

はじめに

AWSユーティリティコンピューティングシニア副社長のPeter DeSantisは、「Monday Night Live」の伝統を続け、AWSサービスとエンジニアリングに関する深いインサイトを紹介しました。

また、AWS独自のアプローチと革新的な文化を通じて、シリコンチップからクラウドサービスまで、パフォーマンスとコスト効率を同時に達成する方法を説明しました。

発表は、ハードウェア設計、データセンターの効率化、クラウドサービスを活用した顧客中心のソリューション開発に焦点を当てています。そして、AWSのイノベーション文化と協力事例は、技術的な発展とビジネス価値の創造にどのようにつながるかを共有しました。

AWS運用メカニズムとリーダーシップが追求するディテール集中

木の根と構造はAWSの構造と似ており、タブルートのように細部に集中して問題を素早く解決し、迅速な意思決定を可能にする組織として維持してきたそうです。具体的には、AWSは毎週すべてのチームが参加する運用会議を通じて詳細に集中できるメカニズムを構築し、組織のあらゆる層で効率的に情報を交換し、詳細についての深い理解のおかげで、AWSはカスタムシリコンに投資というなど長期的で難しい決断が容易にできたそうです。

横方向のルーツ構造のように、AWSは全体的なスタックを含む、電源、ネットワーキング、データベースなどのいくつかの重要なコンポーネントを革新し、独自の能力を備えたと言われています。

AWS NitroとGraviton4のハードウェアベースのセキュリティ

AWS Nitroシステムは、サーバーアーキテクチャを再構築し、クラウドの構築とセキュリティに革新をもたらし、MacなどのさまざまなコンピュータをEC2インスタンスに切り替えることができる柔軟性を提供します。これにより、クラウド環境で効率的で多様なコンピューティングオプションを活用できます。

Nitroはセキュリティの向上とともにハードウェアサプライチェーンの整合性を保証し、暗号化された署名でブートプロセスの各段階を検証し、ハードウェアの作成からワークロードの実行まで整合性を維持します。これによりクラウド運用の信頼性が向上します。

Graviton4プロセッサとの組み合わせにより、システム間で暗号化された通信が可能になり、ハードウェアベースのセキュリティが製造段階から始まります。これは、クラウドでのデータ保護と整合性を維持する上で重要な役割を果たします。

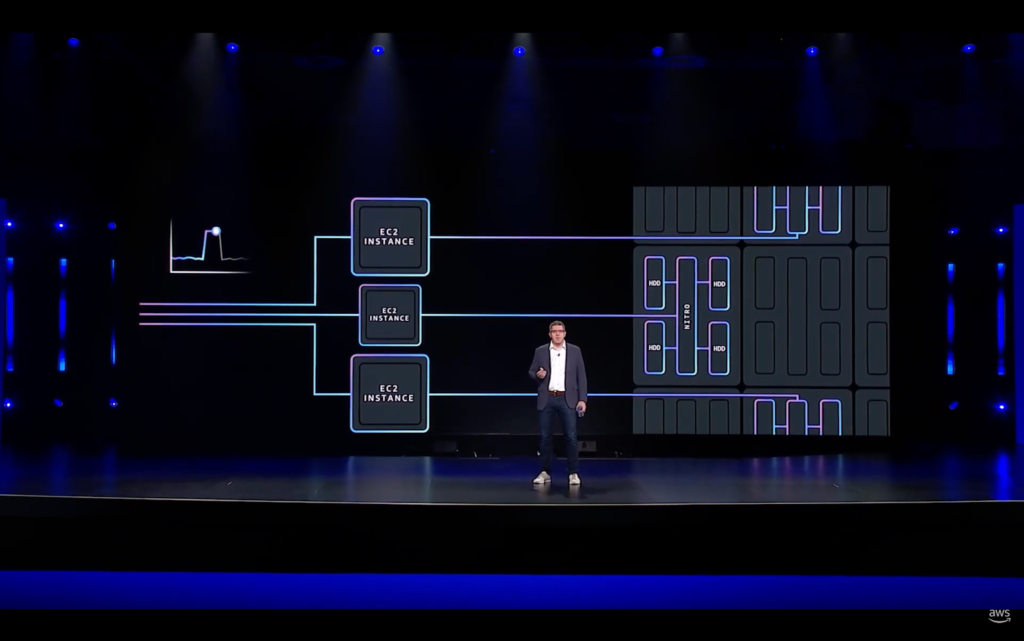

ストレージとコンピューティングの分離:効率と柔軟性の進化

ストレージとコンピューティングの分離概念は、操作の複雑さを軽減し、敏捷性を高めるイノベーションをもたらしました。

Nitroカードを活用し、JBODエンクロージャーに直接つなぎ、物理的な制約から離れて高性能を維持でき、メンテナンスが簡単で、失敗したドライブを可用性に影響を与えず交替できます。

ネットワークを通した独立的なドライブ接近で、伝統的なヘッドノード失敗問題を解決し、早いリカバリをサポートします。

このアーキテクチャは、ストレージとコンピューティングリソースの独立した拡張を可能にし、顧客により良い価値を提供します。

コンピューティングリソースを必要に応じて調整し、ハードウェア制約から離れて運用上の柔軟性を高めました。

メンテナンスが簡単になり、容量計画が柔軟になり、イノベーションが速くなりました。

最初はストレージ密度の問題を解決するために導入されましたが、このアーキテクチャは効率的で、信頼性が高い新しい基本モデルとして発展しました。

変化に適応できる柔軟性を提供し、今後新たな機会を創出する基盤となっています。

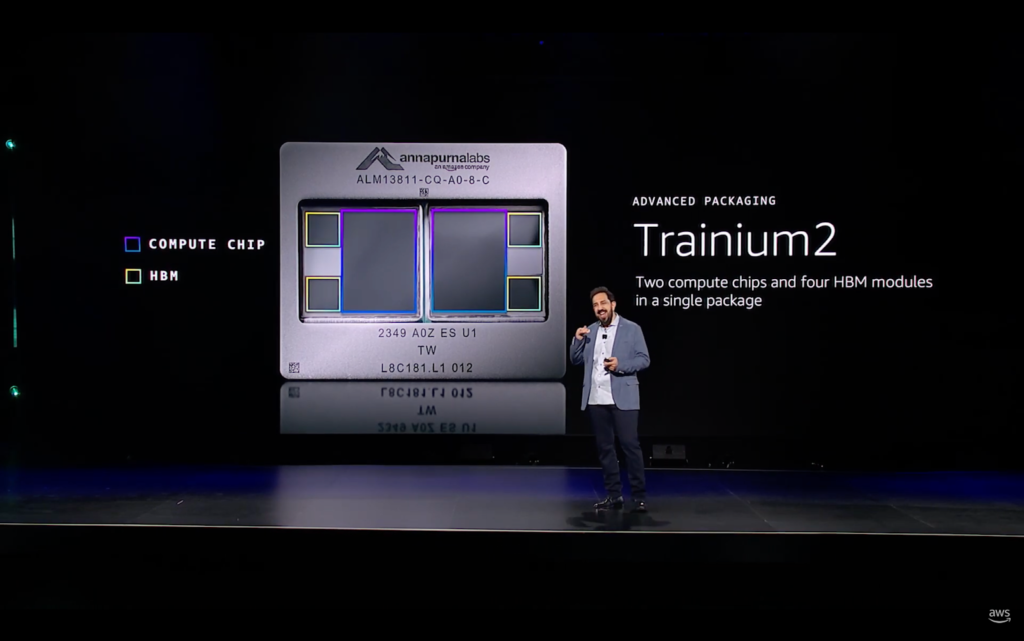

Tranium 2:AIサーバー向けの革新的な設計とパフォーマンス

Tranium 2チップは、シリコンウェーハベースの高度な製造技術で作られており、2つのTraniumチップと高帯域幅メモリ(HBM)モジュールで構成されるパッケージで、AIサーバーの強力なパフォーマンスを提供します。 HBMは低消費電力と効率的な熱管理により高性能を実現し、インターポーザ技術によりチップ間の接続安定性を最大化します。

このチップは電力管理の最適化によって電圧降下を防ぎ、短いワイヤを活用して性能を損なうことなく大規模な演算をサポートします。データセンター環境では、Tranium 2は高い計算効率と一貫したパフォーマンスを維持するように設計されています。

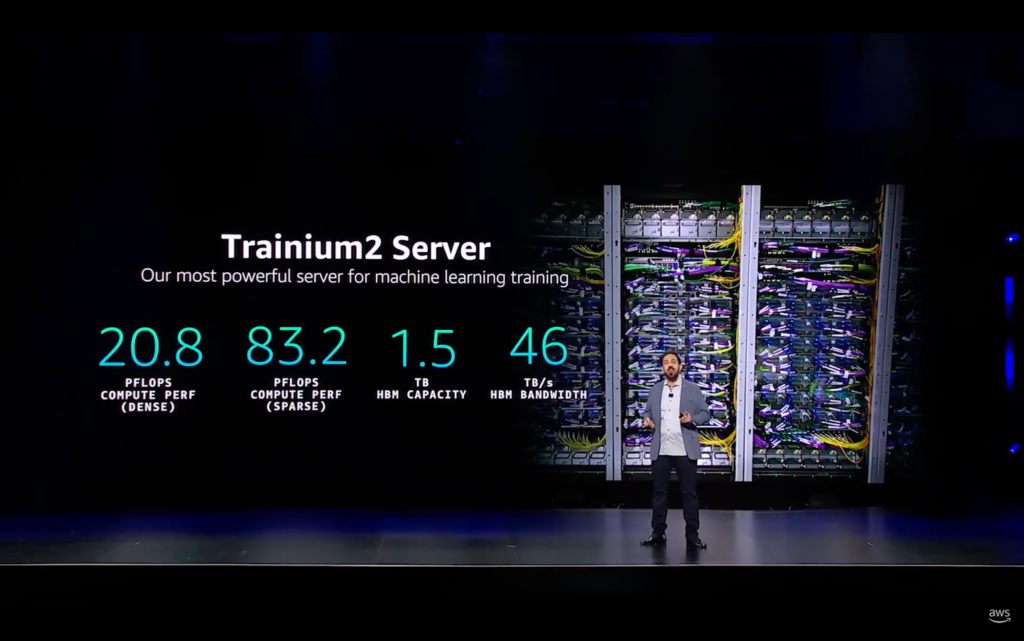

Tranium 2サーバーは20ペタフロップスの容量を提供し、従来のAWS AIサーバーより25%高いパフォーマンスを誇ります。自動化された製造と迅速なスケーラビリティをサポートするユニークな構造で、AI演算に最適化されたプラットフォームを提供します。

NeuronLinkテクノロジは、Tranium Interconnectを利用して複数のTranium 2サーバーを組み合わせて、2TB / sの帯域幅と1マイクロ秒の遅延時間でメモリに直接アクセスできるUltra Server構成を提供します。このUltra Serverは64個のTranium 2チップを連携させ、従来のEC2 AIサーバーと比較して5倍以上のコンピューティング容量と10倍以上のメモリを提供し、トリリアンパラメータAIモデルの構築に不可欠です。これらのサーバーは、AI推論ワークロードを最適化してメモリとコンピューティングリソースの負担を分散させ、AWSのお客様が最高のパフォーマンスを簡単なAPI移行で体験できるように設計されています。

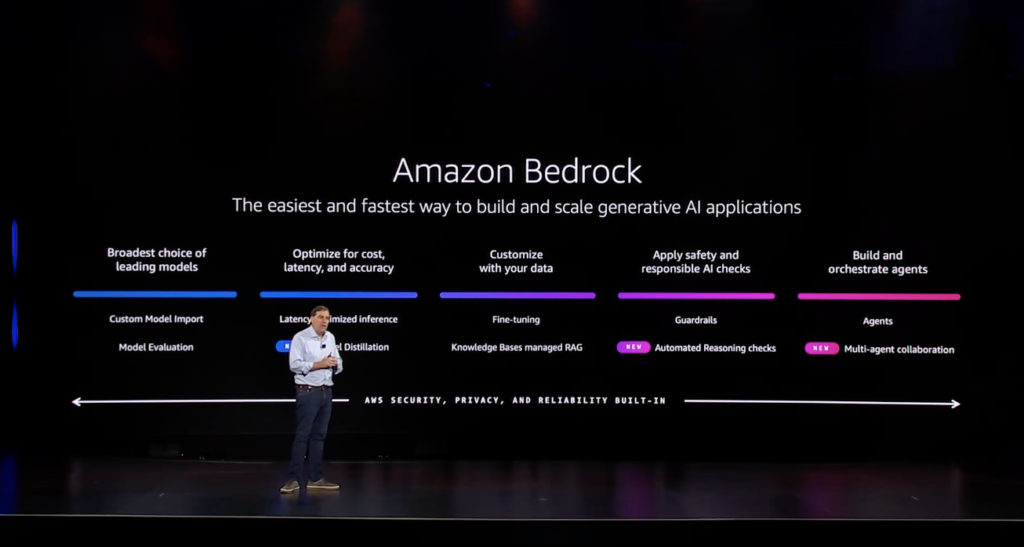

どうやらAIの高速/高性能処理のためのラテンシーが重要になり、シリコンコアの競争とともに、これを支えるネットワークを強化した新機能も – Latency-optimized inference option for Amazon Bedrock – 発表されました。

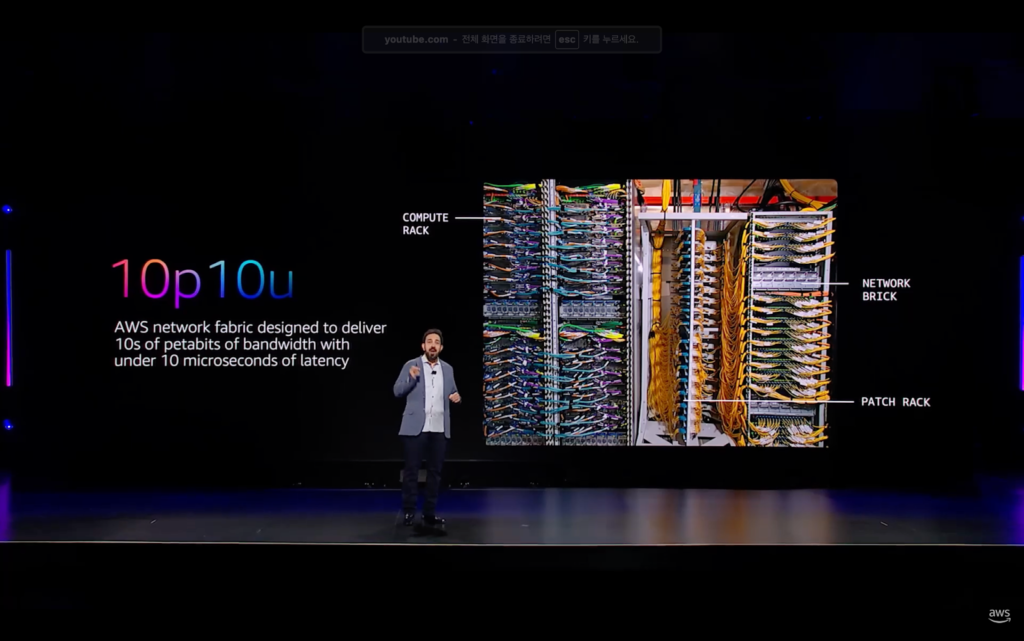

10P10Uネットワークの設計と革新

10P10Uネットワークは、UltraServer2とTraniumおよびNVIDIAベースのクラスタをサポートし、数千台のサーバーにテラバイト級の容量と10マイクロ秒以下の遅延時間を提供します。

超並列仕組みと弾力的なデザインで、いくつかのラックから様々なデータセンターに拡張でき、トランクコネクタとFirefly Optic Plugのような革新的な技術でケーブル接続の問題を解決しました。

また、Scalable Intent Driven Routing(CIDR)を導入し、障害対応時間を1秒以下に短縮し、従来のネットワークに比べ10倍の高速性能を提供します。

まとめ

今年の初日のKeynoteは、Nitro、Graviton、ストレージなどのコアイノベーションからTranium 2を通じて構築中の大規模AIサーバーまで、さまざまな投資と発展が紹介されました。

サービスを支えている基本ハードウェアの投資と市場の要件以上を満たすためAWSの発展が、個人的に、ハードウェアが好きな人としてワクワクがある発表でした。

結局AIを向けて進んで行き、AIが持続的なクラウド拡張のイノベーションのメリットを受けるため、AWS が運営する人や組織とともに、Infrastructureも基本に忠実な姿を見せようとする発表だと思いました。

執筆:MEGAZONECLOUD Cloud Technology Center,Global Pre-Sales Team イ・ヨンジン チーム長

この記事の読者はこんな記事も読んでいます

-

Compliance & Identity re:Invent2024 Security StorageAWS re:Invent 2024 セッションレポート #STG306-R|Amazon S3に対するセキュリティパターンについての深堀り

Compliance & Identity re:Invent2024 Security StorageAWS re:Invent 2024 セッションレポート #STG306-R|Amazon S3に対するセキュリティパターンについての深堀り -

Cloud Operations Compliance & Identity re:Invent2024 SecurityAWS re:Invent 2024 セッションレポート #COP327|AWSベースの生成型AIの監査とコンプライアンスを加速

Cloud Operations Compliance & Identity re:Invent2024 SecurityAWS re:Invent 2024 セッションレポート #COP327|AWSベースの生成型AIの監査とコンプライアンスを加速 -

Compliance & Identity Networking re:Invent2024 SecurityAWS re:Invent 2024 セッションレポート #NET205|集中型ネットワーク・トラフィック・インスペクション:重要な洞察と学び

Compliance & Identity Networking re:Invent2024 SecurityAWS re:Invent 2024 セッションレポート #NET205|集中型ネットワーク・トラフィック・インスペクション:重要な洞察と学び